Wir hatten schon einmal kurz in einer News darauf hingewiesen, dass sich Photoshops "Generative Fill"-Möglichkeiten auch mit einer kleinen Trickserei auf Bildteile mit bewegten Videoinhalten anwenden lassen. Und so ist das Sommerloch vielleicht die ideale Zeit, das ganze einmal schnell selbst mit einem Workshop in der Praxis auszuprobieren. Vielleicht lässt sich das ganze ja auch noch mit einer virtuellen Zoomfahrt zu garnieren, die beliebig lange dauern kann.

Beta ist (noch) Pflicht

Für diesen Workshop ist bis auf weiteres noch die spezielle, aktuelle Betaversion von Adobes Photoshop aus der Cloud vonnöten, denn in einer finalen Version sind die neuen KI-Funktionen noch nicht zu finden. Alternativ lässt sich dieses Verfahren auch mit Stable Diffusion nutzen, jedoch haben wir den Eindruck, dass unsere Leser eher die Adobe Creative Cloud als Stable Diffusion zur Hand haben. Bein entsprechendem Interesse können wir die notwendigen, alternativen Schritte in Stable Diffusion aber noch in einem eigenen Workshop nachreichen...

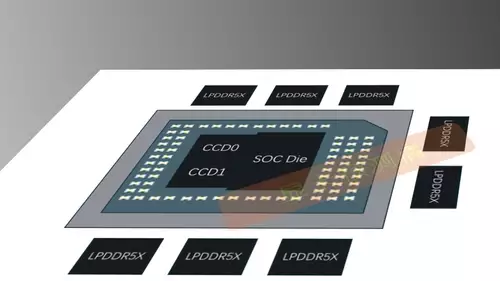

Die besagte Funktion in der aktuellen Photoshop Beta nennt sich "Generative Fill" und basiert auf einem generativen KI-Modell, welches maskierte Bereiche in einem Bild schlüssig ergänzen kann. Wie bei Stable Diffusion kann man hiermit nicht nur Objekte löschen oder verändern. Ein Bild kann hiermit ebenso über seinen Rahmen hinaus erweitert werden - indem Adobes KI das präsentierte Bildmotiv optisch "weiterspinnt".

Bei Bewegtbildern funktioniert eine solche Erweiterung allerdings nicht, weil hier für jeden Frame eines Videos ein anderer Inhalt erfunden wird - was die zeitliche konsistente Abfolge der Einzelbilder (zer)stört. Das Video wirkt im besten Falle sehr unruhig, im schlechtesten Fall bekommt man eine Abfolge unzusammenhängender Einzelbilder präsentiert.

Rahmenbedingungen

Was jedoch durchaus funktioniert, ist eine fiktive Rahmenerweiterung, solange die Kameraposition statisch ist - sprich mit einem Stativ aufgenommen wurde. Solange keine Objekte wie z.B. Vögel oder Schatten in den ursprünglichen Rahmen eintreten oder diesen verlassen, kann ein statischer Bereich um das Video "erfunden" werden. Zur Verfeinerung kann man noch mit virtuellen Kamerabewegungen die gefühlte Authentizität erhöhen. Theoretisch lässt sich dabei auch ein beliebig großer Rahmen erfinden, dessen virtuelle Zoomfahrt erst zum Schluss in einem wirklich bewegten Video endet.

Wie das recht einfach funktioniert, wollen wir nun einmal Schritt für Schritt exemplarisch erklären.